基于自适应观测器的永磁同步直线电机模型预测控制系统设计

为了优化永磁同步直线电机的调速性能,解决永磁同步直线电机对速度传感器依赖程

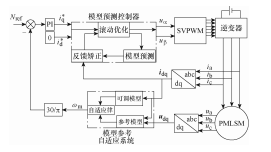

度高的问题,该文设计一种带模型参考自适应观测器的永磁同步直线电机预测电流控制系统

(MPC-MRAS)。利用去除交叉耦合电动势的定子电压方程设计模型预测电流控制器,取代传统电流控制器;自适应观测器的参考模型利用电机的实际模型进行设计,可调模型利用估计的电流模型进行设计,电机估值速度通过参考模型和可调模型的电流差值设计的自适应律得出。该方案不仅降低电流控制器对电机参数的依赖程度,消除电流耦合对模型预测控制器的影响;同时,还使控制系统的复杂性和成本得到了简化,提高控制系统的控制性能和抗干扰能力。利用仿真软件搭建预测控制器和自适应观测器应用于电机控制系统验证所提控制策略的优越性。经过验证该控制策略可以实现对速度进行在线准确辨识,并且还可以有效地减少电流纹波和提高电流的跟踪性能。

- 2021-06-18

- 阅读1628

- 下载0

- 11页

- pdf